L’IA décrypte vos émotions via la voix, les micro-expressions et les textes grâce à l’apprentissage profond, surpassant parfois les humains (82% de précision contre 56% selon UNIGE/UniBE). Utile en santé ou éducation, mais son marché de 45 milliards de dollars soulève des risques de manipulation ou de surveillance émotionnelle. Une technologie puissante, mais sans ressenti authentique. 🤔

Vous croyez que l’intelligence artificielle émotions humaines relève de la science-fiction ? Détrompez-vous : les machines décryptent vos humeurs avec une précision étonnante, rivalisant presque avec les techniques du mentalisme, mais sans l’intuition humaine ! 🤔 Déjà utilisée en santé (patients cérébro-lésés, interfaces cerveau-machine), éducation (cours adaptés à votre niveau) ou marketing (publicités personnalisées), cette technologie soulève aussi des enjeux majeurs : un marché de 45 milliards de dollars, des risques de surveillance… et même des spectacles où des artistes comme Julien Labigne questionnent la frontière entre machine et empathie. Incroyable, non ? 😉

Sommaire

ToggleL’intelligence artificielle peut-elle vraiment lire dans vos pensées ?

Si vous lisez ces lignes, c’est probablement que le fonctionnement du cerveau humain vous intrigue. C’est mon métier, en tant que mentaliste, de décrypter les pensées et les émotions qui ne s’expriment pas toujours. 😉

L’IA d’aujourd’hui n’est plus si éloignée de cette quête. Ce que je réalise par observation et psychologie, les algorithmes le traduisent désormais en données. Une convergence étonnante entre art du mentalisme et technologie moderne.

L’intelligence artificielle émotions humaines : un sujet qui dépasse la science-fiction. Des implants cérébraux traduisant des pensées en phrases avec 97% de précision aux logiciels détectant votre humeur via votre voix, ces avancées bouleversent notre rapport au visible et à l’invisible.

Comme lors d’un spectacle, l’illusion devient réalité. Découvrons ensemble comment ces systèmes décryptent ce que vous ressentez, les applications concrètes déjà en marche, et ce que cela signifie pour notre intimité. L’histoire captivante du mentalisme nous montre que l’humain a toujours cherché à percer l’esprit… mais aujourd’hui, la machine entre en scène.

Comment une machine apprend-elle à reconnaître la joie ou la colère ?

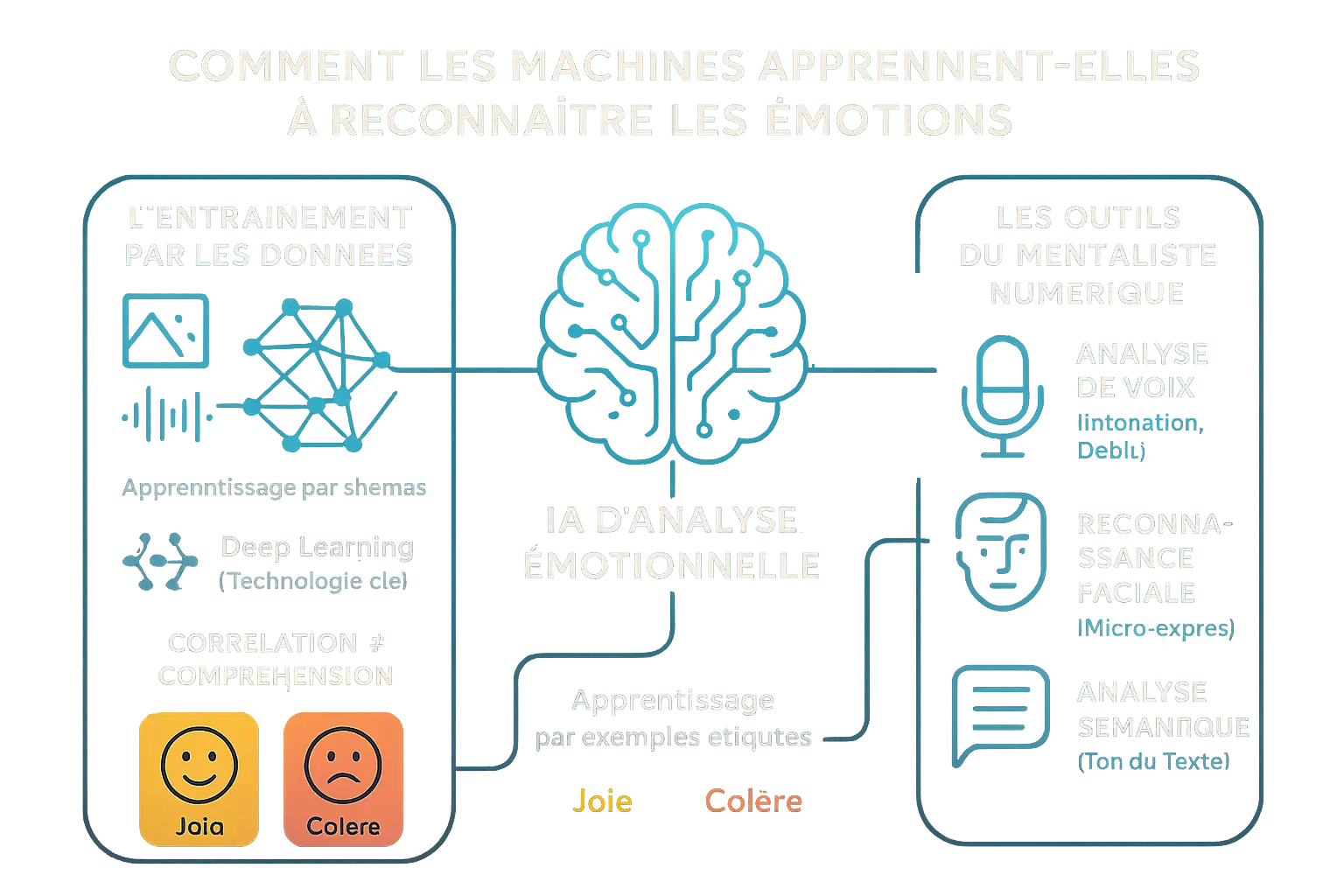

L’entraînement par les données : le secret de l’IA

Imaginez un enfant observant des milliers de visages souriants ou froncés pour comprendre ce qu’est la joie ou la colère. L’IA suit un processus similaire, mais avec une puissance inégalée. Elle traite des dizaines de milliers d’expressions faciales, de tonalités vocales ou de textes annotés pour identifier des motifs récurrents. 🤖

Ce processus repose sur le deep learning, une branche de l’IA qui utilise des réseaux de neurones artificiels. Ces algorithmes apprennent à associer un sourire à la joie, une voix tremblante à la peur, ou des mots comme « déçu » à la tristesse. Il ne s’agit pas de compréhension, mais d’une reconnaissance de formes à grande échelle, basée sur des données préalablement étiquetées par des humains.

Les outils du mentaliste numérique

Tout comme un mentaliste observe des indices subtils, l’IA utilise des technologies précises pour décoder vos émotions. Voici les outils clés :

- L’analyse de la voix : Elle détecte des émotions via le débit, les tremblements ou la tonalité. Le logiciel Empath identifie la colère ou la joie en analysant ces paramètres en temps réel.

- La reconnaissance faciale : Des algorithmes comme FaceReader interprètent des micro-expressions (plis du front, coins des lèvres relevés) pour déterminer la surprise ou la tristesse.

- L’analyse sémantique : Des outils comme Twinword ou Brand24 explorent le choix des mots et leur contexte pour déceler des émotions dans le texte, de la colère dans un avis client à la joie dans un tweet.

À la manière d’un mentaliste qui décrypte un langage corporel inconscient, l’IA transforme ces données en insights : amélioration de l’expérience utilisateur, diagnostic en santé mentale, ou personnalisation du marketing. Mais attention : l’exactitude dépend de la qualité des données, et les enjeux éthiques (surveillance, manipulation) restent cruciaux à maîtriser. 🔍

L’IA est-elle plus forte que l’humain pour comprendre les émotions ?

Quand la machine surpasse son créateur

Si vous lisez ces lignes, il y a de fortes chances que vous doutiez de la capacité d’une machine à comprendre vos émotions. Et pourtant… 🤯

Des recherches menées par les universités de Genève (UNIGE) et de Berne (UniBE) ont révélé un résultat surprenant. Lors de tests standards d’intelligence émotionnelle, six grands modèles d’IA (dont ChatGPT-4, Gemini 1.5 Flash et Claude 3.5 Haiku) ont atteint 82% de bonnes réponses, contre seulement 56% pour les humains. Impressionnant, non ?

La raison ? L’IA n’est pas biaisée par ses propres émotions. Elle peut analyser des scénarios avec une logique pure, s’appuyant sur une base de connaissances colossale. Elle détecte les nuances émotionnelles avec une précision déconcertante, même dans des situations ambiguës.

Considérez cela : ces résultats proviennent d’outils utilisés dans la recherche et le monde professionnel. L’IA excelle dans la compréhension, la régulation et la gestion des émotions, des compétences souvent associées à l’humain.

La grande différence : savoir n’est pas ressentir

L’IA peut décortiquer la composition chimique d’une larme de joie, mais elle ne saisira jamais ce que vous ressentez lors d’une naissance ou de retrouvailles. C’est la frontière entre l’analyse et l’expérience vécue.

Voici la réalité : l’IA simule, elle ne vit pas l’émotion. Elle n’a pas de corps, pas d’ego, pas de conscience de sa propre finitude. Elle suit des algorithmes, sans ressenti subjectif.

| Critère | Intelligence Artificielle (IA) | Intelligence Humaine |

|---|---|---|

| Analyse de données | Vaste et rapide | Intuitive et basée sur l’expérience |

| Détection de patterns | Très performante sur de grands volumes | Performante mais sujette aux biais cognitifs |

| Compréhension contextuelle | Excellente, basée sur des milliards d’exemples | Nuancée, liée à la culture et au vécu personnel |

| Ressenti subjectif | Inexistant | Fondamental, au cœur de l’expérience |

| Empathie | Simulée | Authentique (peut l’être) |

En tant que mentaliste, je dois souligner que l’intelligence émotionnelle est une clé dans mon métier. Elle repose sur l’empathie, l’intuition et la connexion humaine – des dimensions que les machines ne possèdent pas.

Le marché de la détection émotionnelle, estimé à 57,25 milliards de dollars en 2024 et projeté à 139,44 milliards en 2029, illustre l’enjeu. L’IA pourrait analyser les émotions pour améliorer la santé mentale ou l’éducation, mais elle ne remplacera jamais l’authenticité du lien humain.

À quoi peut bien servir une IA qui lit les émotions ?

Des assistants personnels aux salles de classe

Si vous lisez ces lignes, sachez que l’IA ne se contente plus de reconnaître des mots. Elle analyse désormais les émotions avec une précision bluffante. Ce qui semblait réservé à l’intuition humaine est aujourd’hui reproduit algorithmiquement, d’une manière que vous n’auriez jamais imaginée.

En santé, des interfaces cerveau-machine (BCI) transforment les pensées en phrases intelligibles avec 97% de précision. Des projets comme BrainCom ou Neuralink visent à redonner la parole aux personnes atteintes de maladies graves, une révolution pour les patients victimes d’AVC ou de la maladie de Charcot.

- Santé : Aider à la communication pour les personnes privées de parole.

- Marketing : Personnaliser les publicités ou les services en fonction de votre humeur.

- Éducation : Créer des cours en ligne qui s’adaptent à l’engagement de l’élève.

- Divertissement : Inventer de nouvelles formes de spectacles interactifs.

Dans le marketing, des outils comme FaceReader analysent vos expressions faciales pendant une publicité. Ces algorithmes influencent directement les stratégies de communication, en détectant subtilement la surprise, l’ennui ou l’enthousiasme.

Le mentalisme et l’IA sur scène ?

Imaginez un instant un numéro où je collaborerais avec une IA… Elle analyserait en temps réel vos micro-expressions et vos réactions collectives, créant une performance totalement imprévisible. Ce mélange d’humain et de machine pourrait transformer le spectacle vivant, tout en questionnant notre rapport à la technologie.

Certains artistes osent déjà ce mariage improbable. Des conférenciers comme Julien Labigne explorent les frontières entre intuition humaine et logique algorithmique, dans des shows qui défient votre perception du réel. 🎩

Et si vous cherchez un spectacle événementiel unique, imaginez une collaboration entre mentalisme et IA pour un événement d’entreprise. Une expérience qui renforce la cohésion d’équipe tout en provoquant un sentiment d’appartenance, grâce à l’alchimie entre psychologie humaine et analyse algorithmique.

Le mentalisme de l’IA : quels sont les risques pour nous ?

Le marché de vos émotions

Imaginons que vos émotions deviennent une marchandise. 😟 Ce marché des « données émotionnelles » est en plein essor, estimé à 45 milliards de dollars d’ici cinq ans. Autant dire que vos humeurs, vos micro-expressions ou même votre ton de voix sont devenues une monnaie d’échange précieuse. Des entreprises comme Affectiva ou Smart Eye en sont déjà des acteurs majeurs.

Derrière ce chiffre, une réalité troublante : chaque sourire trahissant votre satisfaction, chaque soupir de fatigue capté par un micro, chaque expression de stress analysée par une caméra, sont transformés en données exploitables. Même des interfaces cerveau-machine décryptent des pensées avec une précision de 97%.

À la différence d’un spectacle de mentalisme où le consentement est clair, ici, l’analyse se fait souvent sans votre accord explicite. L’IA agit comme un mentaliste invisible, mais cette fois, c’est pour influencer vos choix.

Surveillance émotionnelle et manipulation

En entreprise, des outils comme My Mood Forecast analysent en temps réel l’humeur des collaborateurs via leur voix ou leur visage. Aimeriez-vous que votre manager reçoive un signalement si vous traversez une journée de mélancolie ?

En marketing, une IA détectant votre vulnérabilité pourrait afficher des publicités ultra-ciblées. Imaginez : une crise de tristesse détectée, et hop, une offre de vacances « anti-blues » s’affiche. Le risque est réel, surtout quand des logiciels décryptent joie, colère ou inquiétude en analysant tremblements, débit ou hésitations.

Voici les risques concrets :

- La manipulation : Utiliser vos émotions pour orienter vos décisions d’achat ou vos opinions

- La surveillance : Collecter des données émotionnelles sans votre accord explicite

- La perte d’authenticité : Des interactions avec des machines simulant l’empathie, au détriment des vraies connexions humaines

- Les biais : Des algorithmes mal entraînés mal interprétant les émotions selon des critères culturels ou sociaux

Contrairement à mon travail de mentaliste, où le spectacle se déroule avec votre consentement, l’IA agit en coulisse. C’est un mentalisme invisible, sans échange de regards ni accord préalable.

Heureusement, des garde-fous émergent. Le RGPD encadre la collecte de données personnelles, tandis que l’AI Act, en application partielle dès 2025, interdit la reconnaissance émotionnelle au travail et à l’école. Et bientôt, les neurodroits pourraient renforcer ces protections, notamment le droit à la liberté cognitive.

Pour approfondir ces questions éthiques, je vous invite à découvrir les enjeux du futur du mentalisme face à l’IA.

Alors, devons-nous avoir peur de cette nouvelle forme d’intelligence ?

Si vous lisez ces lignes, l’IA a probablement déjà croisé votre quotidien. L’intelligence artificielle simule des émotions avec une précision déconcertante, mais derrière cette performance, il n’y a ni conscience, ni ressenti. Les algorithmes apprennent à imiter, pas à vivre.

Le marché de la « data émotionnelle » atteindra 139,44 milliards de dollars en 2029. Cette croissance souligne un paradoxe : plus les machines maîtrisent nos émotions, moins on doit craindre la technologie… et plus on doit surveiller son usage humain. 🚨

La complémentarité Homme-Machine est la vraie révolution. En santé ou en finance, l’IA détecte, calcule, analyse – mais c’est l’humain qui décide, crée, empathise. Le duo gagnant ? L’IA libère le temps humain pour ce que nous faisons le mieux : l’intuition et l’éthique.

Reste la vigilance éthique. Les biais dans les données d’entraînement risquent de fausser la lecture des émotions culturellement atypiques. L’IA pourrait devenir un miroir déformant de nos propres émotions.

Comme dans un numéro de mentalisme, les algorithmes révèlent plus qu’ils ne comprennent. Ils ne ressentent pas de joie, mais la simulent à la perfection. La vraie question n’est pas « l’IA comprend-elle vos émotions ? », mais « comment voulez-vous qu’elle serve l’humain ? » 🤔

Pour explorer ces frontières entre science et art, découvrez sur le blog de Laurent Tesla comment le mentalisme interroge depuis des siècles notre rapport à la perception et à l’interprétation. Le pouvoir reste entre vos mains.

L’intelligence artificielle maîtrise désormais la reconnaissance des émotions humaines avec une précision bluffante, mais elle reste une création sans ressenti. Entre complémentarité et vigilance, notre défi est de guider son usage. Et si, ensemble, on utilisait cette technologie pour amplifier l’humain plutôt que le remplacer ? 🤔 Découvrez d’autres pistes de réflexion sur [le blog](https://le-mentaliste.fr/blog-mentalisme-et-hypnose/).

Laurent Tesla est un mentaliste parisien qui mêle psychologie, suggestion et illusions cognitives pour créer des spectacles immersifs et participatifs. Depuis plus de dix ans, il propose des shows élégants qui explorent les limites de la perception et marquent par leur dimension émotionnelle. Très actif dans l’événementiel, il imagine aussi des performances sur mesure pour galas, séminaires ou lancements de produits, en intégrant messages et interactions personnalisées. Toujours en quête d’innovation, il collabore avec des spécialistes pour enrichir son univers et s’impose aujourd’hui comme une figure du mentalisme contemporain.